Command Palette

Search for a command to run...

在线教程丨基于 500 万小时语音数据,Qwen3-TTS 实现 3 秒语音克隆及精细调控

当生成式 AI 不再局限于「生成文字」,而是开始真正「发出声音」,语音就从信息通道升级为可编程、可塑造的表达媒介。从跨语种内容创作到实时语音助手,从虚拟主播到沉浸式交互系统,文本转语音(TTS)正在成为多模态模型体系中的核心一环。但要让机器说得自然、稳定、可控,并在流式场景下保持毫秒级响应,背后考验的不只是声学建模能力,更是架构设计与系统优化的综合实力。

在这一技术演进路径上,新一代模型开始尝试突破传统 TTS 的边界——不仅追求更高保真度,还强调多语言泛化能力与精细化控制能力。由 Qwen 团队日前开源的 Qwen3-TTS 便是基于双轨语言模型(LM)架构,在实时语音合成的同时,也可对输出语音进行细粒度调控。

具体而言,Qwen3-TTS 支持 3 秒语音克隆与基于描述的语音控制,其在覆盖 10 种语言、总计超过 500 万小时的语音数据上进行训练,同时还配备两种语音分词器(speech tokenizer):

* Qwen-TTS-Tokenizer-25Hz:采用单码本(single-codebook)编解码器,侧重语义内容表达,可与 Qwen-Audio 无缝集成,并通过基于分块(block-wise)的 DiT 实现流式波形重建。

* Qwen-TTS-Tokenizer-12Hz:实现极致码率压缩与超低延迟流式输出,基于 12.5Hz 、 16 层多码本设计以及轻量级因果卷积网络(causal ConvNet),可实现 97 毫秒的首包即时输出。

大量实验结果表明,该系列模型在 TTS 多语言测试集、 InstructTTSEval 等多项客观与主观基准测试中,均达到 SOTA 水平。

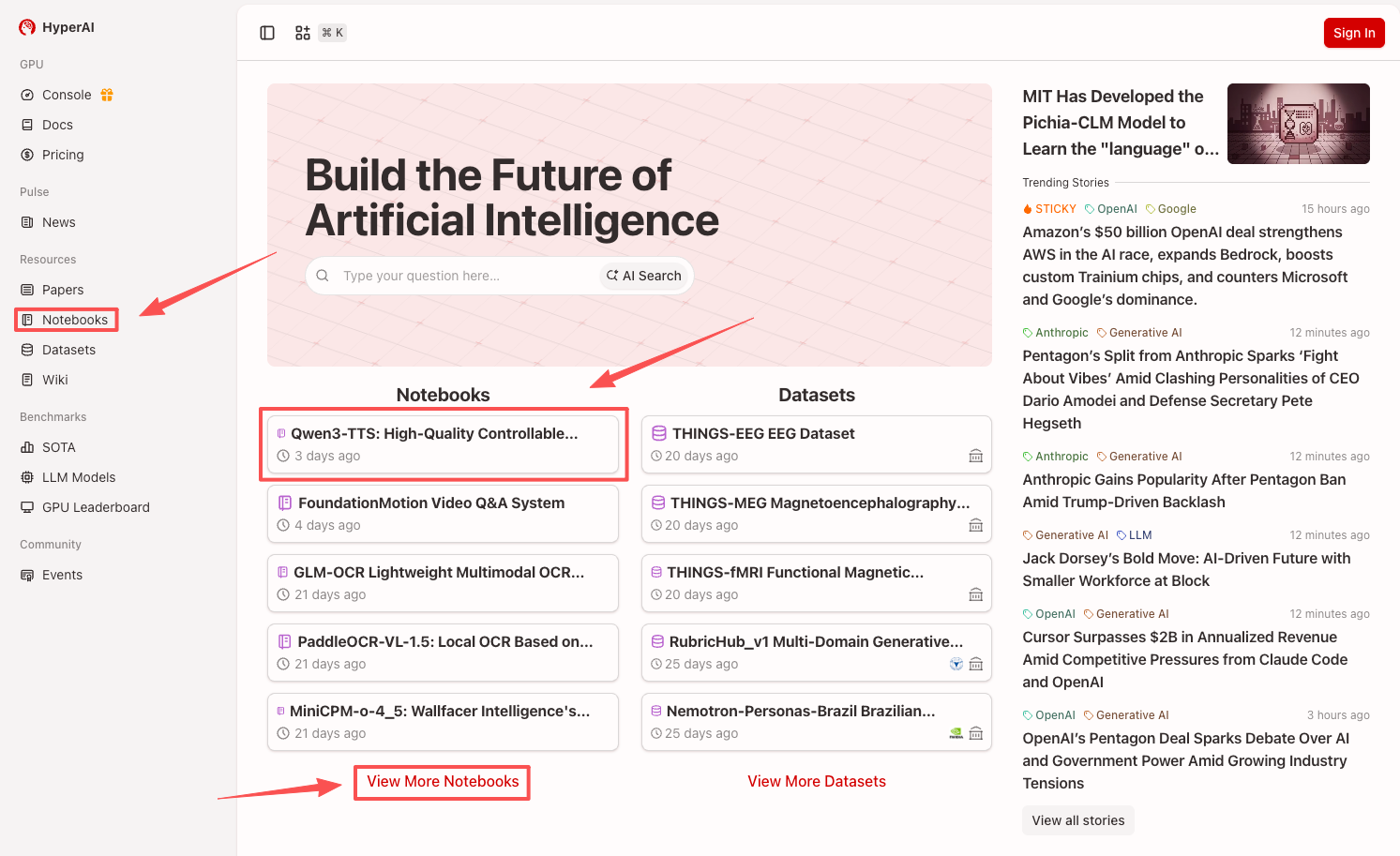

目前,「Qwen3-TTS:高质量可控多语言语音合成 Demo」已上线至 HyperAI 超神经官网的「教程」板块,快来体验 3 秒语音克隆吧!

在线教程:

查看论文:

Demo 运行

1. 进入 hyper.ai 首页后,选择「教程」页面,或点击「查看更多教程」,选择「Qwen3-TTS:高质量可控多语言语音合成 Demo」,点击「在线运行此教程」。

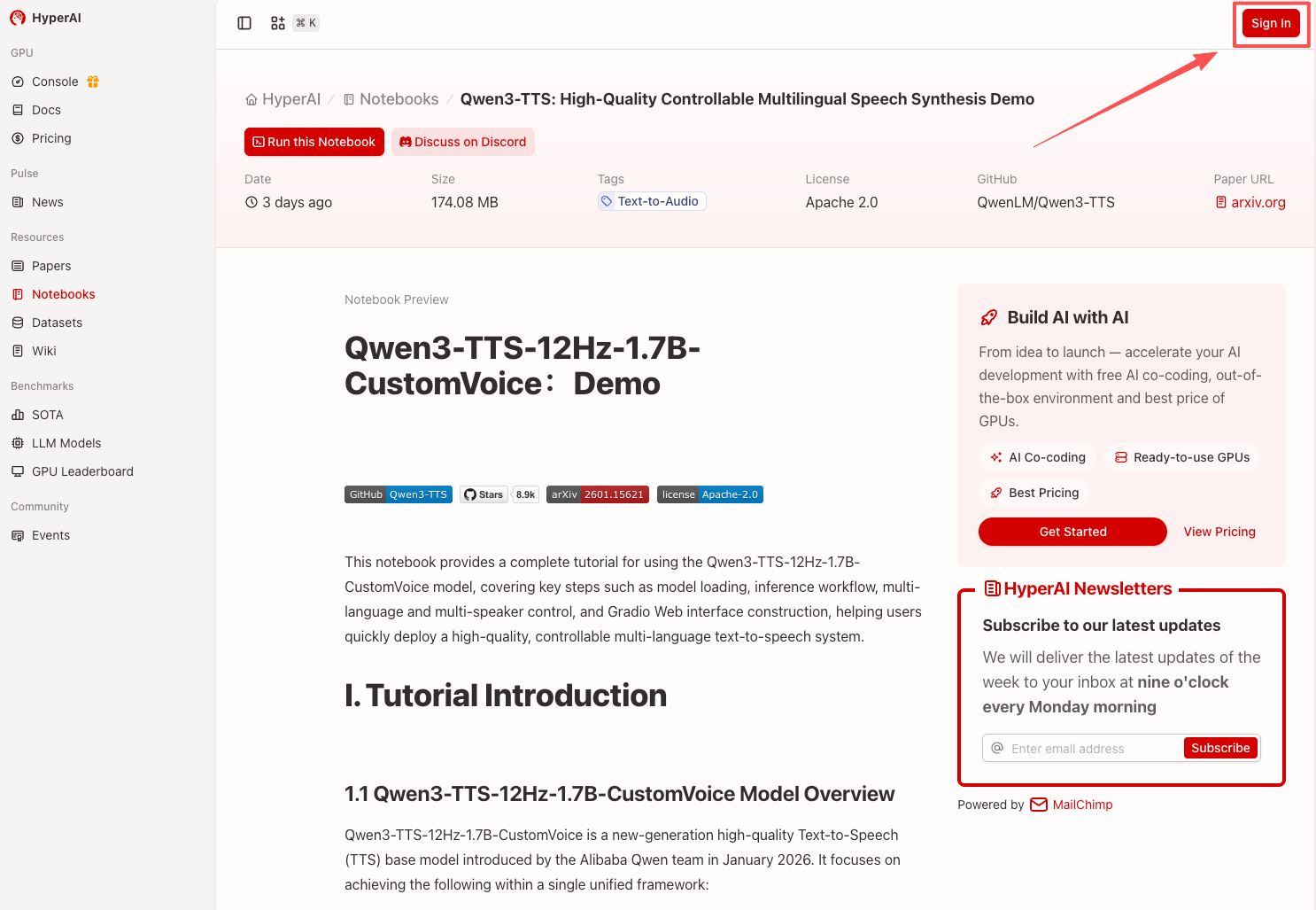

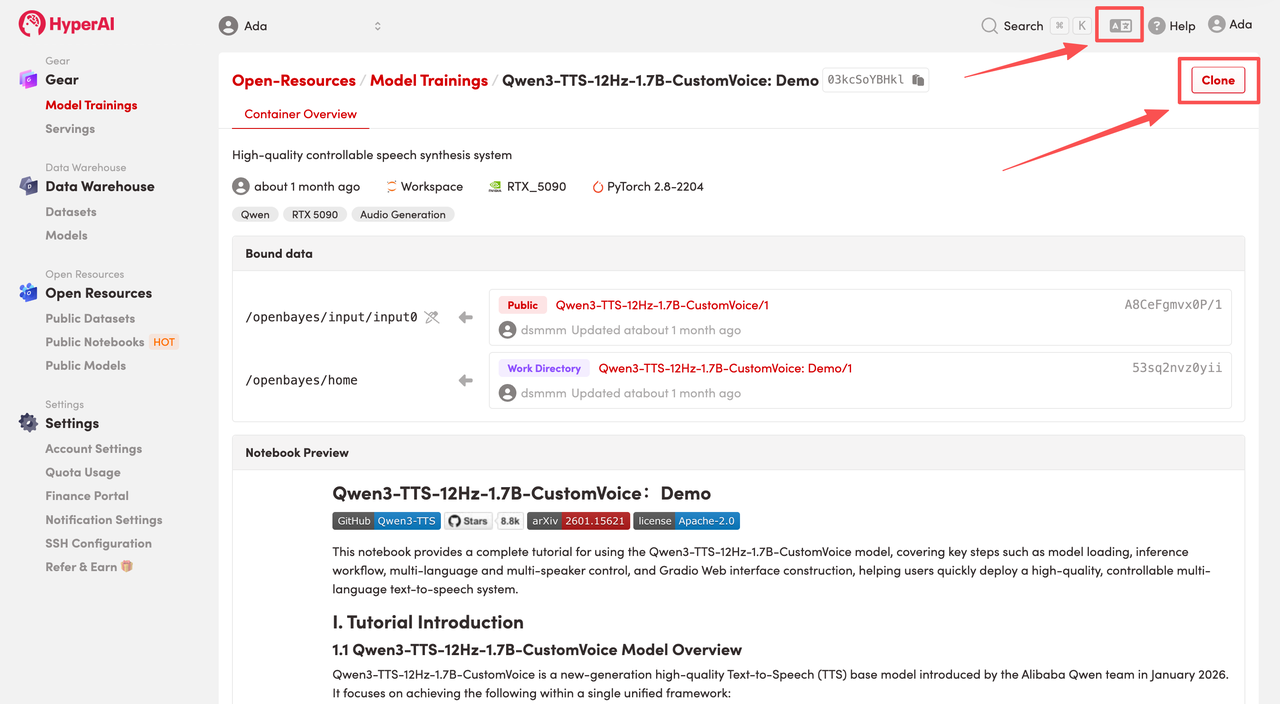

2. 页面跳转后,点击右上角「Clone」,将该教程克隆至自己的容器中。

注:页面右上角支持切换语言,目前提供中文及英文两种语言,本教程文章以英文为例进行步骤展示。

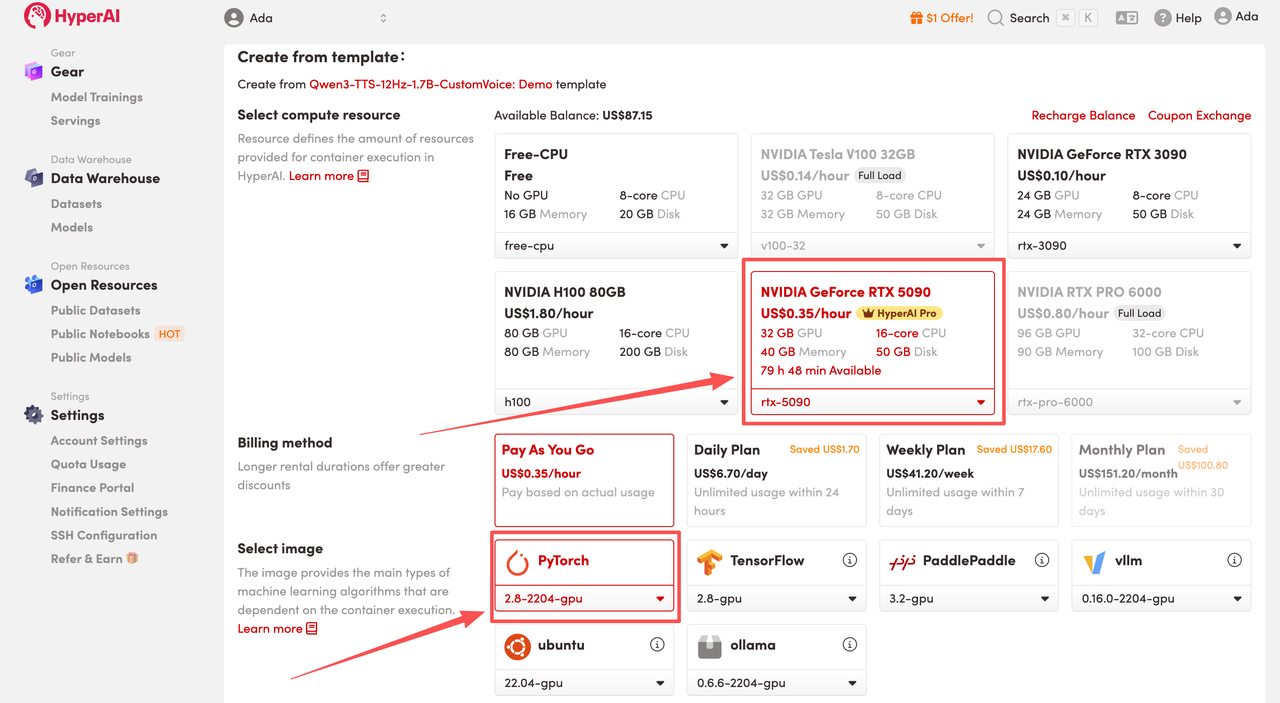

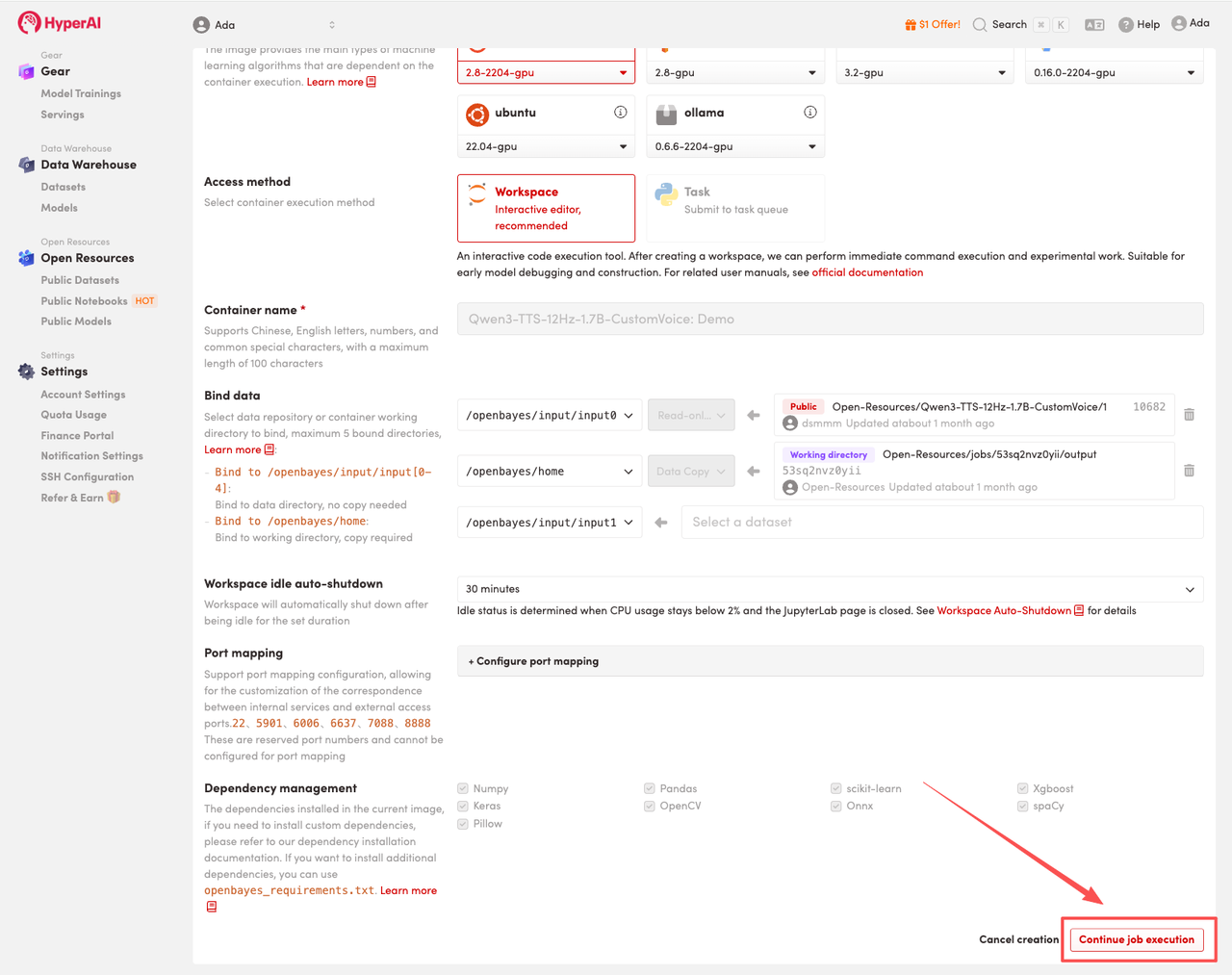

3. 选择「NVIDIA GeForce RTX 5090」以及「PyTorch」镜像,按照需求选择「Pay As You Go(按量付费)」或「Daily Plan/Weekly Plan/Monthly Plan(包日/周/月)」,点击「Continue job execution(继续执行)」。

HyperAI 为新用户准备了注册福利,仅需 $1,即可获得 20 小时 RTX 5090 算力(原价 $7),资源永久有效。

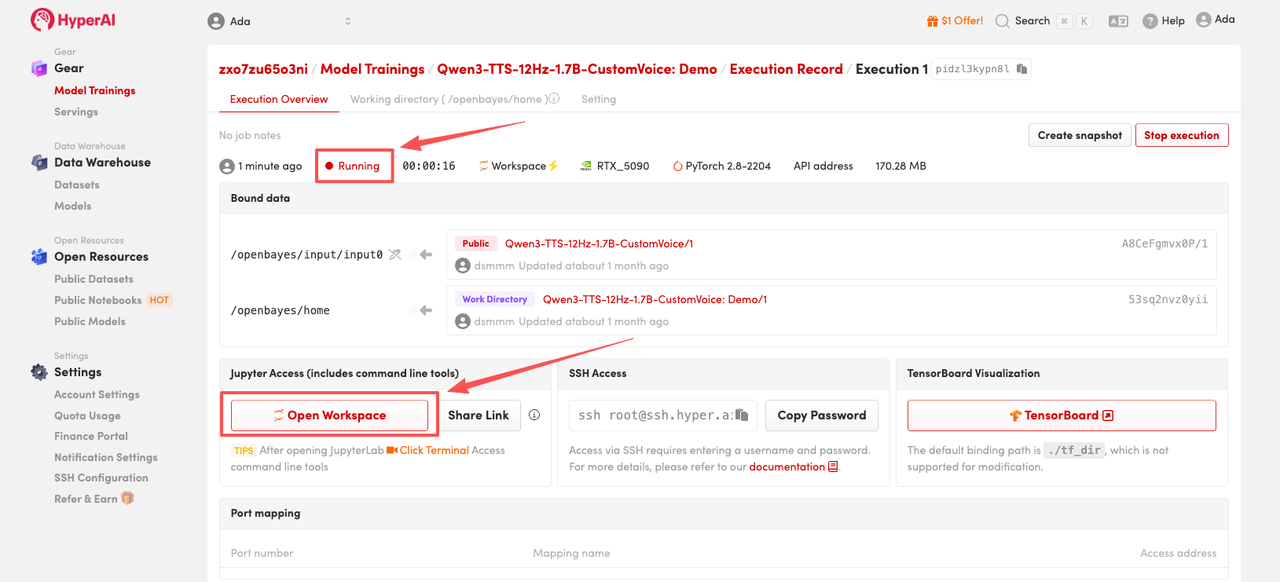

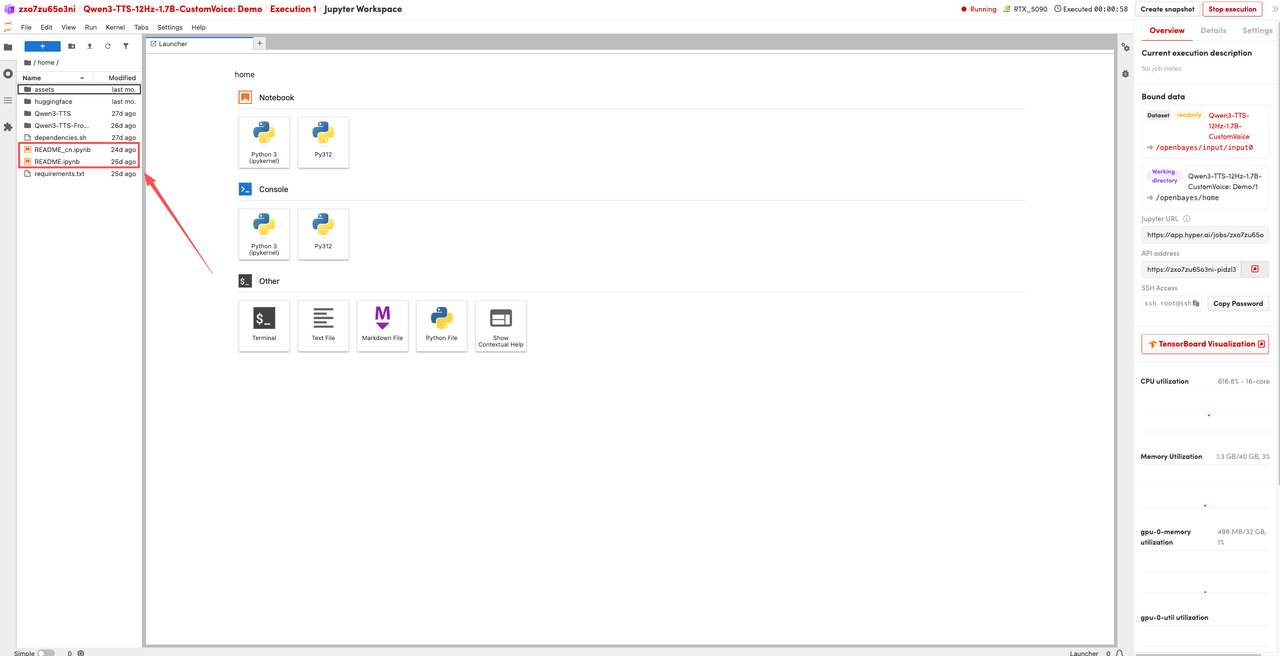

4. 等待分配资源,当状态变为「Running(运行中)」后,点击「Open Workspace」进入 Jupyter Workspace 。

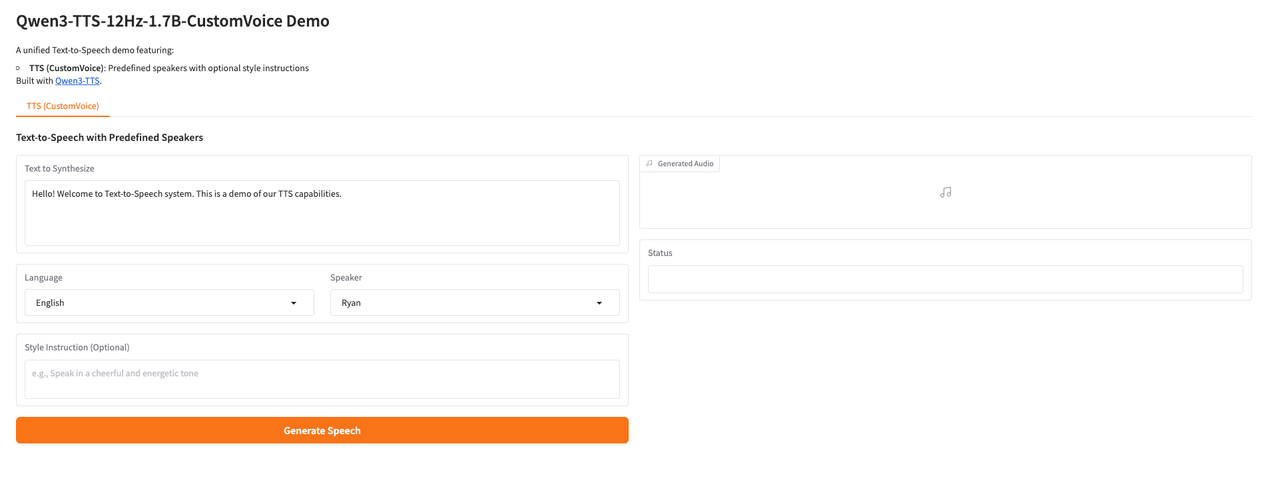

效果演示

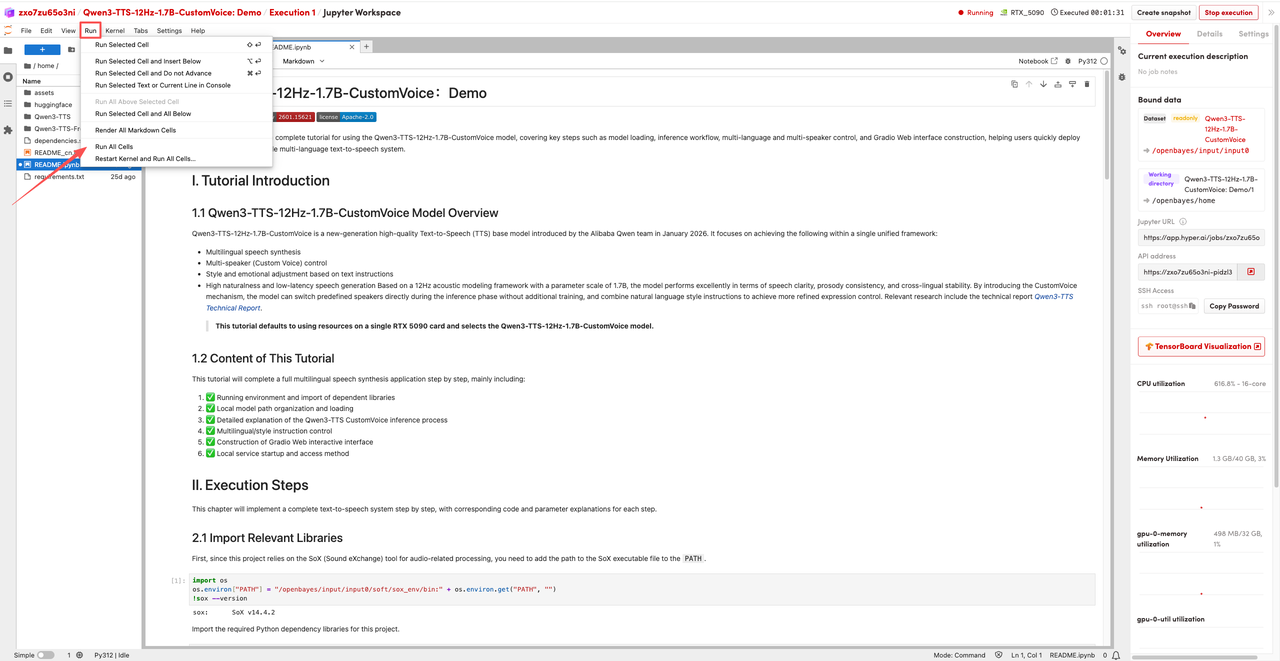

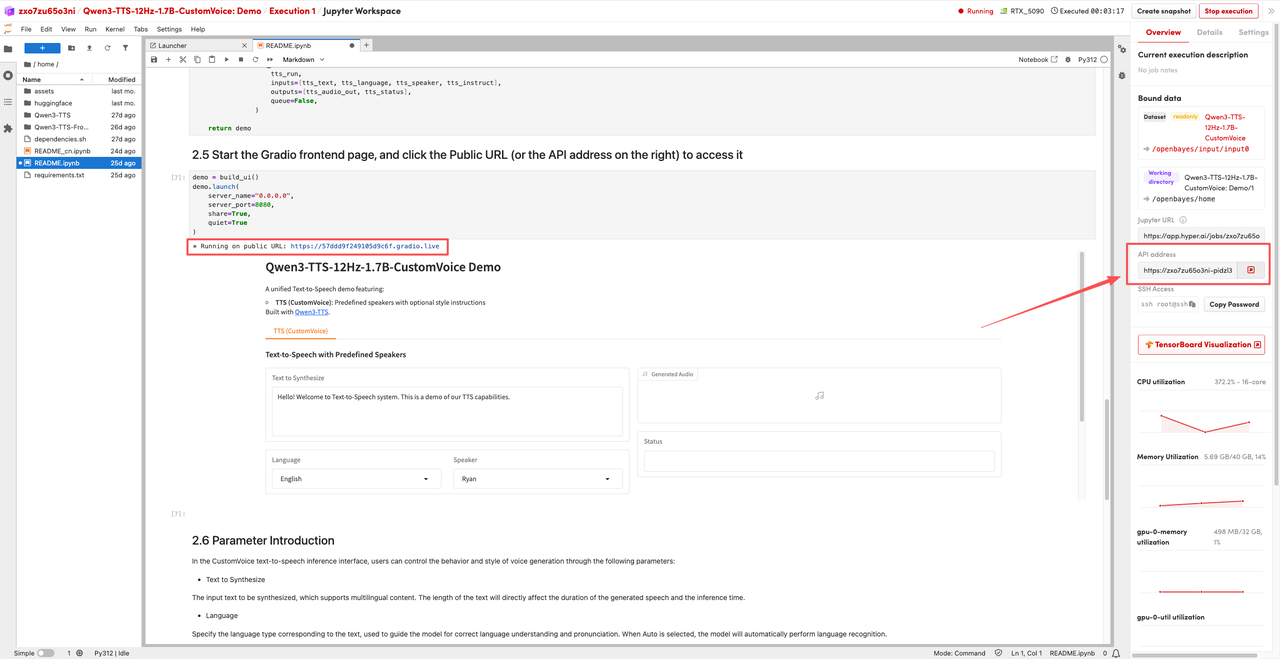

1. 页面跳转后,点击左侧 README 页面,进入后点击上方 Run(运行)。

2. 待运行完成,即可点击右侧 API 地址跳转至 demo 页面。

以上就是 HyperAI 超神经本期推荐的教程,欢迎大家前来体验!