Command Palette

Search for a command to run...

SpikingBrain-1.0 基于内生复杂性的类脑脉冲大模型

一、教程简介

「瞬悉 1.0」(SpikingBrain-1.0)是由中国科学院自动化研究所联合脑认知与类脑智能全国重点实验室、沐曦集成电路有限公司等机构于 2025 年 9 月的发布原生国产自主可控类脑脉冲大模型。 SpikingBrain 受大脑机制启发,将混合高效注意力机制、 MoE 模块和脉冲编码集成到其架构中,并由与开源模型生态系统兼容的通用转换管道支持。这使得能够使用不到 2% 的数据进行持续预训练,同时实现与主流开源模型相当的性能。 SpikingBrain 在 4M-token 序列的 TTFT 中实现了超过 100 倍的加速,而脉冲编码在微观层面提供了超过 69% 的稀疏性。结合宏观层面的 MoE 稀疏性,这些进展为下一代神经形态芯片的设计提供了宝贵的指导。相关论文成果为 SpikingBrain Technical Report: Spiking Brain-inspired Large Models 。

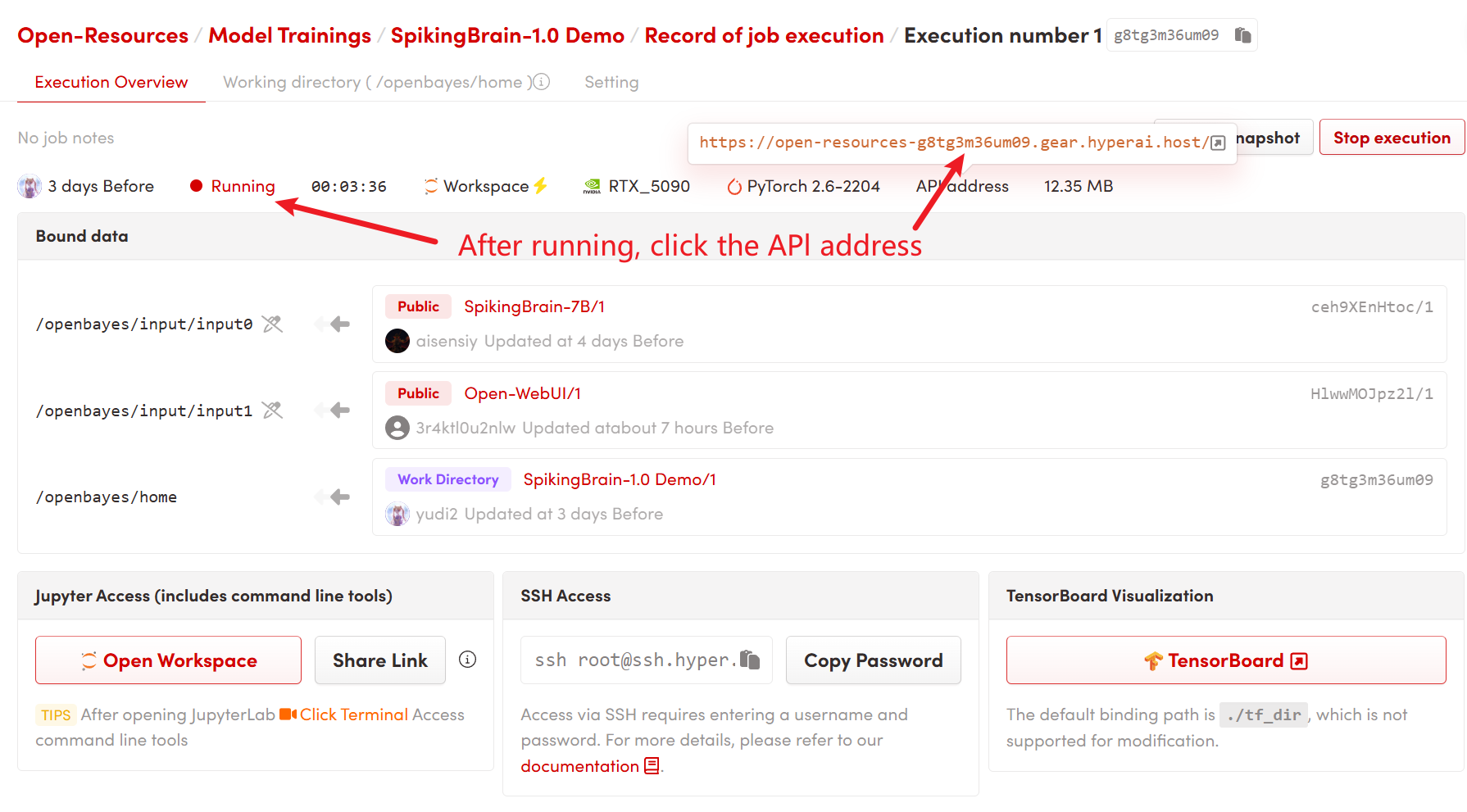

该教程算力资源采用单卡 RTX 5090,本教程部署的模型为 SpikingBrain 的 V1-7B-sft-s3-reasoning 。

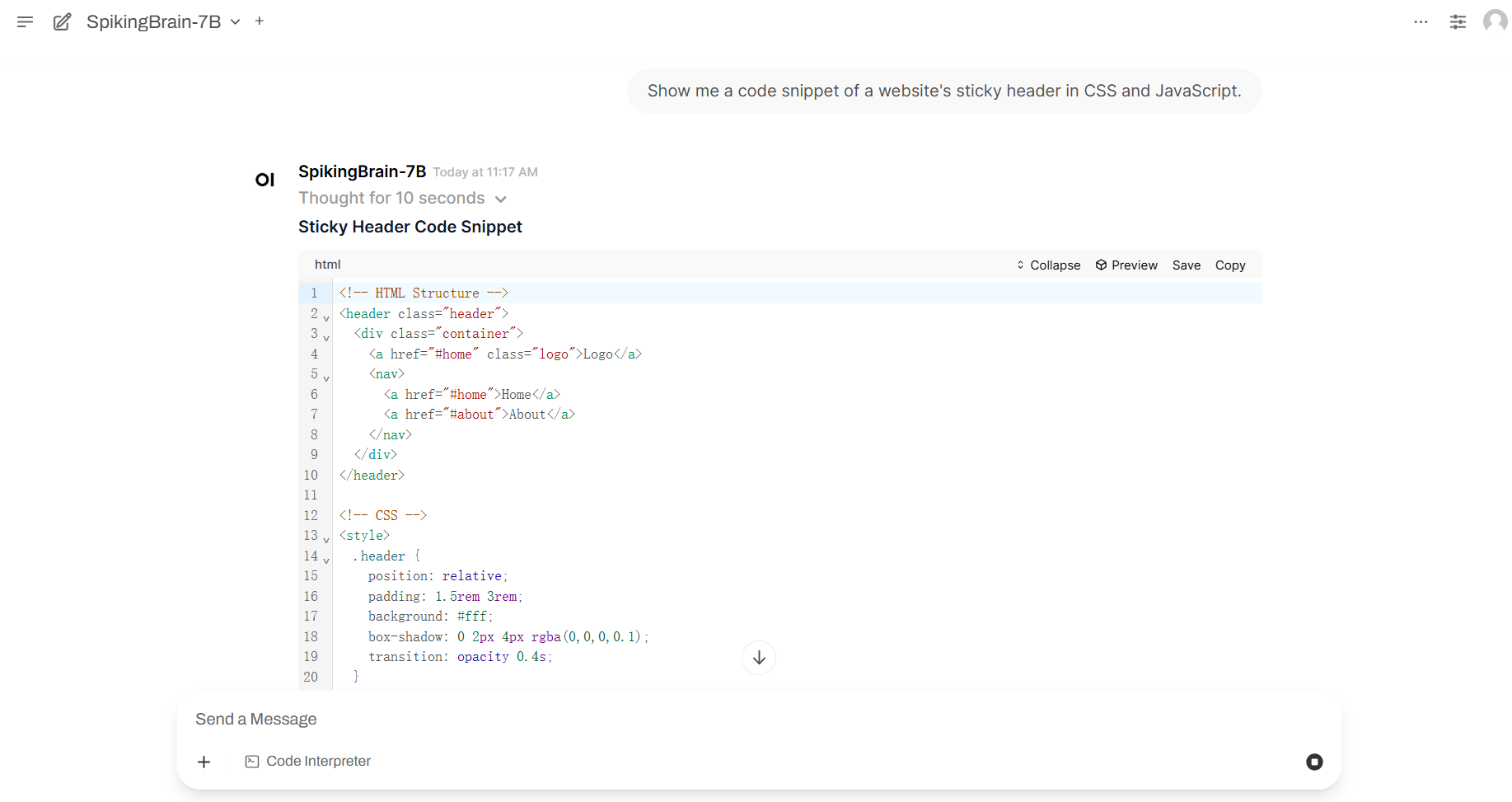

二、效果展示

三、运行步骤

1. 启动容器

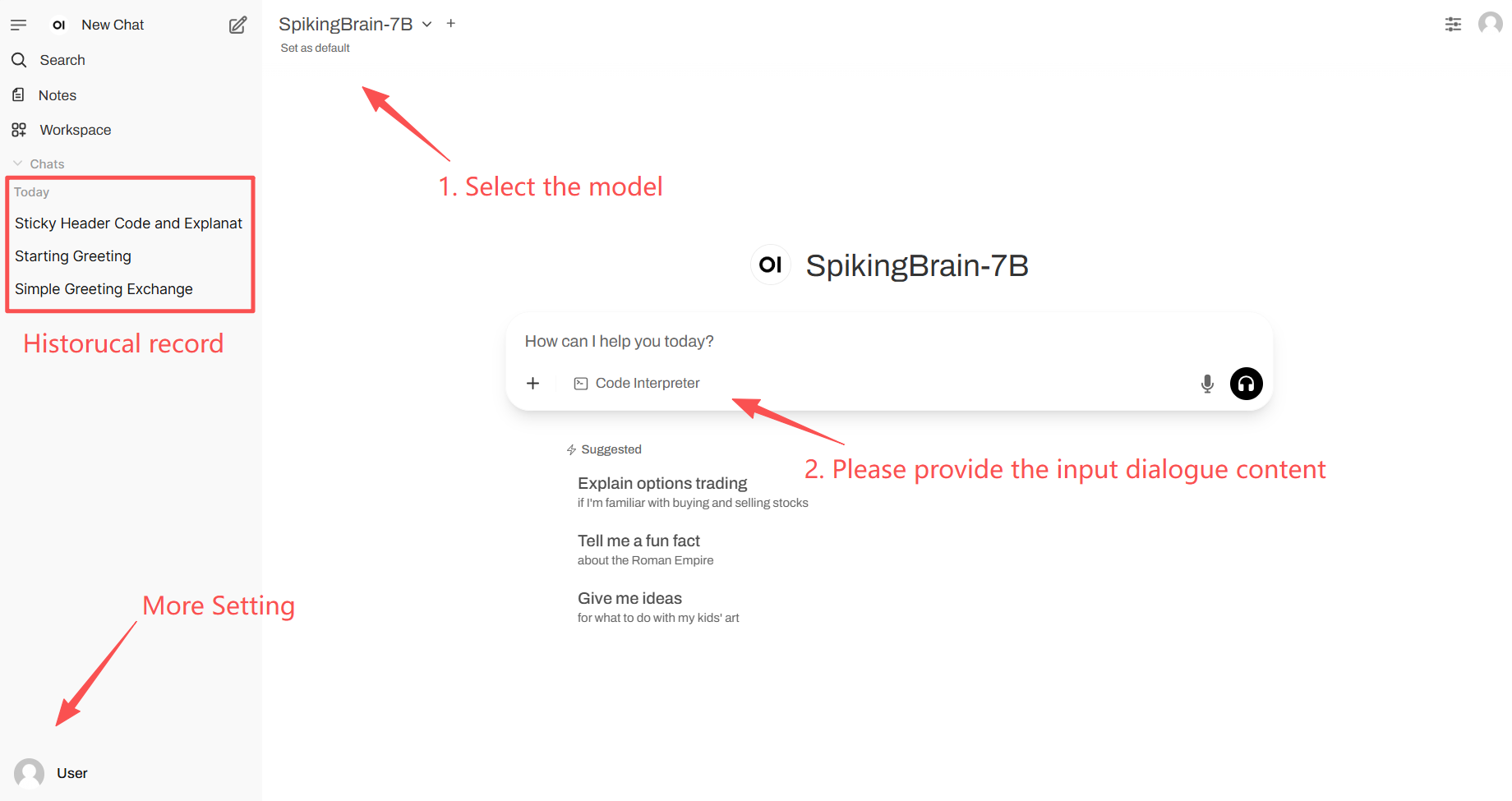

2. 使用步骤

若不显示「模型」,这表示模型正在初始化,由于模型较大,请等待约 2-3 分钟后刷新页面。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【AI4S 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

感谢 Github 用户 SuperYang 对本教程的部署。本项目引用信息如下:

@article{pan2025spikingbrain,

title={SpikingBrain Technical Report: Spiking Brain-inspired Large Models},

author={Pan, Yuqi and Feng, Yupeng and Zhuang, Jinghao and Ding, Siyu and Liu, Zehao and Sun, Bohan and Chou, Yuhong and Xu, Han and Qiu, Xuerui and Deng, Anlin and others},

journal={arXiv preprint arXiv:2509.05276},

year={2025}

}